量子計算是計算科學的前沿領域,其核心是利用量子比特(qubit)的疊加與糾纏特性執行運算。與傳統計算機的經典比特(0或1)不同,量子比特可以同時處于0和1的疊加態,使得量子計算機在處理特定問題上具有指數級加速潛力。要在量子計算機上編程,尤其是針對量子處理單元(QPU),需要掌握一套獨特的編程方法和工具。

1. 理解量子計算的基礎概念

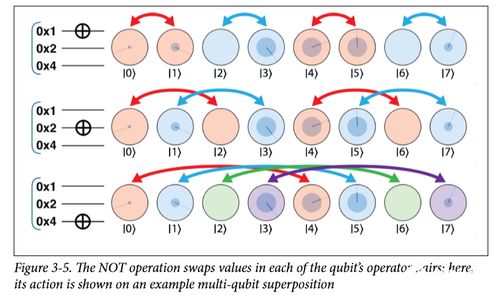

在開始QPU編程前,首先需熟悉量子力學原理,如疊加、糾纏和量子門操作。量子門類似于經典邏輯門,但作用于量子比特,包括哈達瑪門(H)、CNOT門等,用于構建量子電路。例如,一個簡單的量子程序可能涉及初始化量子比特、應用一系列量子門,最后進行測量以獲取結果。

2. 學習量子編程語言和框架

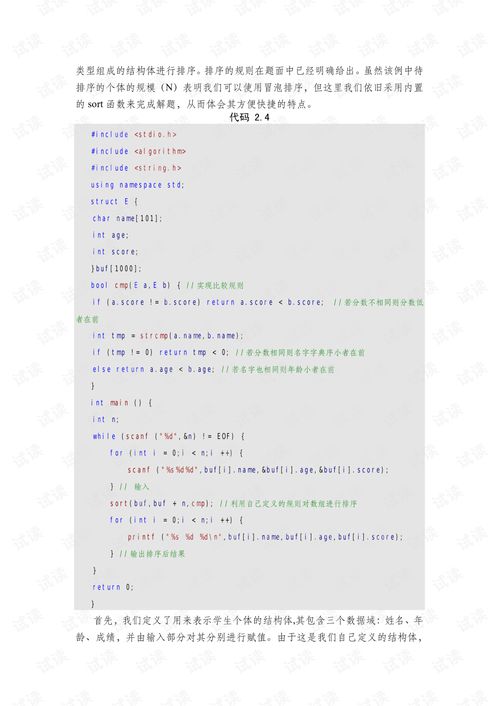

目前,有多種量子編程語言和框架可供選擇,幫助開發者抽象底層硬件細節。其中,Qiskit(由IBM開發)和Cirq(由Google開發)是流行的開源工具。Qiskit基于Python,提供豐富的庫來設計、模擬和運行量子電路。以下是一個使用Qiskit創建簡單量子程序的示例:`python

from qiskit import QuantumCircuit, Aer, execute

# 創建一個量子電路,包含1個量子比特和1個經典比特

qc = QuantumCircuit(1, 1)

# 應用哈達瑪門,創建疊加態

qc.h(0)

# 測量量子比特到經典比特

qc.measure(0, 0)

# 使用模擬器運行電路

simulator = Aer.getbackend('qasmsimulator')

result = execute(qc, simulator, shots=1024).result()

print(result.get_counts())`

這個程序演示了如何生成一個隨機比特,結果中0和1的出現概率大致相等,體現了量子疊加的特性。

3. 連接QPU硬件與模擬環境

實際編程中,開發者通常先在模擬環境中測試量子電路,再部署到真實QPU上。云平臺如IBM Quantum Experience和Amazon Braket提供了訪問真實量子硬件的途徑。編程時需考慮QPU的限制,如量子比特數量、噪聲水平和連接性,這可能影響電路設計和優化策略。例如,在噪聲較大的設備上,需要引入錯誤緩解技術或使用更穩健的量子算法。

4. 探索量子算法與應用場景

QPU編程的核心在于實現量子算法,如Shor算法(用于大數分解)和Grover算法(用于數據庫搜索)。這些算法展示了量子計算的潛力,但實際編程中往往需要結合經典計算機進行混合計算。例如,變分量子算法(VQE)使用經典優化器來調整量子電路參數,適用于化學模擬等領域。編程時,開發者需將問題轉化為量子可解的形式,并設計高效的量子電路。

5. 實踐與資源推薦

入門QPU編程,建議從在線課程和文檔入手,如Qiskit教科書或Microsoft Quantum Development Kit教程。通過動手項目,如構建簡單的量子游戲或解決優化問題,可以加深理解。參與量子計算社區(如GitHub上的開源項目)有助于跟上技術發展。

QPU編程是一個跨學科的領域,融合了物理、計算機科學和數學知識。雖然目前量子硬件仍處于發展初期,但掌握其編程方法將為未來計算革命奠定基礎。從模擬環境起步,逐步深入算法和硬件優化,開發者可以在這個快速發展的領域中探索創新應用。